Tomará tiempo reproducir toda la inteligencia humana. Las computadoras ya pueden hacer infinidad de cosas que rebasan nuestras habilidades, pero hay muchas otras capacidades intelectuales que el ser humano apenas ha empezado a desarrollar.

| Artículo de Luis A. Pineda y Raymundo Morado

En el imaginario colectivo, las computadoras son “superhumanas”, dotadas de competencias mentales que antes, para muchos, eran consideradas exclusivamente de los seres humanos: hablar, conocer, pensar, aprender… incluso, sentir y ser conscientes.

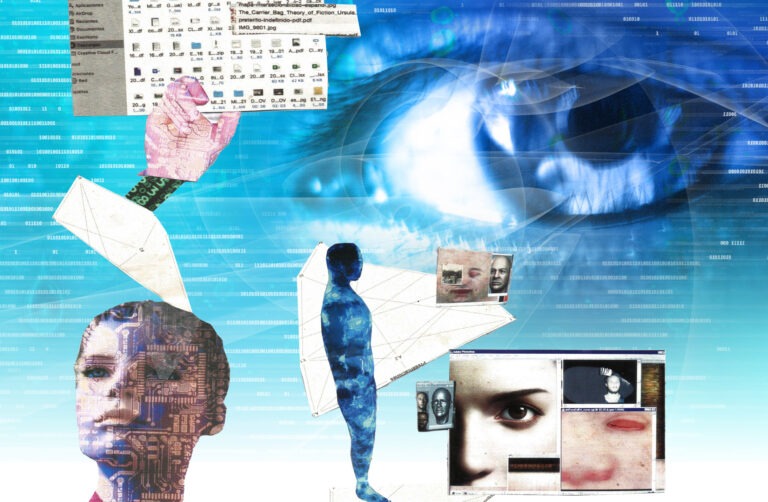

Esta percepción se debe, en buena medida, a la disponibilidad generalizada de computadoras personales, teléfonos celulares y dispositivos similares que permiten acceder a la información global, las redes sociales y a herramientas de apoyo para el desempeño de actividades de la vida diaria. Estas tecnologías visibles se montan sobre otras tecnologías más profundas que, para el usuario final, son invisibles, como los sistemas de comunicaciones (en particular internet) con todo el andamiaje tecnológico que los hace posible, los sistemas de monitoreo y seguridad urbanos, las bases de datos masivas y las interfaces que combinan imágenes, textos y voz.

Tales herramientas han permitido recolectar y utilizar una inmensa cantidad de datos de la dinámica social, como los sistemas de seguridad que registran todo lo que se mueve o las aplicaciones para navegar en el tránsito cotidiano. Las tecnologías de cómputo y comunicaciones se organizan en jerarquías de varios niveles, como los bancos de primero, segundo y tercer piso, donde los ciudadanos comunes sólo tenemos acceso al primero; las empresas al segundo, y sólo los gobiernos y los grandes conglomerados mundiales al tercero.

No todo lo computado es inteligente

El cine y la televisión nos muestran un mundo en el que lo humano se transfiere a lo maquinal. Las computadoras son, en este sentido, como los juguetes a los que la niña o el niño adscriben atributos humanos para jugar con ellos. Esta adscripción no hace humanos a los juguetes, pero sí hace que el comportamiento de los niños cambie al jugar con ellos.

Debemos ser realistas sobre las computadoras. El hecho de que algo esté programado no significa, necesariamente, que sea inteligente. Tanto los modelos simbólicos como los neuronales de la computación tienen limitaciones. Por ejemplo, las redes neuronales no tienen la capacidad de manipular símbolos, son muy limitadas para modelar el pensamiento, incluyendo la toma de decisiones, y más bien se enfocan en la construcción de esquemas que conectan directamente la percepción con la acción motora. Aquí hay una especie de acuerdo o avenimiento entre ambos enfoques: mientras la computación simbólica se enfoca en el pensamiento, pero da por sentada la interpretación, las redes neuronales se enfocan en la percepción y la acción, pero a costa del pensamiento.

Lo que tenemos hoy en día es una gran abundancia de datos, pero no necesariamente de información. Tener creencias y conocimientos exige capacidades mentales mucho más sofisticadas que la mera posesión de datos.

De la misma forma en que no todo lo que se computa es acertado, no todo lo inteligente puede ser computado todavía. Tomará tiempo reproducir toda la inteligencia humana, por no hablar de la inteligencia sobrehumana. Las computadoras ya pueden hacer muchas cosas que rebasan las capacidades humanas, pero hay muchas otras capacidades intelectuales que apenas están en vías de desarrollo.

Se puede decir que cuando hablamos del “conocimiento” en los bancos de datos o de la “inteligencia” de los agentes artificiales, estamos abusando de los términos. Después de todo, llamar a una gran concentración de datos un “banco de conocimientos” es una exageración.

Es necesario distinguir entre datos e información, incluyendo las creencias y el conocimiento. Mientras que los datos son registros en medios materiales —como los dibujos y textos en un cuaderno de notas o su expresión digital en las memorias RAM de las computadoras—, la información surge de su interpretación por los seres humanos y se manifiesta como creencias y conocimiento. Un dibujo de los anillos de crecimiento de un tronco es un dato, pero su interpretación como la edad del árbol es información que se constituye, primero, como una creencia y, al confirmarse, como conocimiento. Las señales astronómicas masivas que recopilan los telescopios son datos, y sólo se convierten en información cuando son interpretados por los astrónomos.

Lo que tenemos hoy en día es una gran abundancia de datos, pero no necesariamente de información. Tener creencias y conocimientos exige capacidades mentales mucho más sofisticadas que la mera posesión de datos. Antropomorfizar demasiado pronto a los sistemas computacionales y no tomar en cuenta las distinciones señaladas —hechas con éstas o con otras palabras—, con el agravante de que los mismos datos pueden ser sujetos de interpretaciones muy diversas, da lugar a mucha confusión. La formación humanística favorece que se hagan y aprecien estas distinciones no sólo por la sociedad en general sino, incluso, por los técnicos y los teóricos de la Inteligencia Artificial (IA).

Para hablar de la IA sin confusiones debemos refinar el uso de los conceptos. Y, también, refinar los conceptos mismos. No hay algo sagrado en las nociones intuitivas de inteligencia (o de artificialidad) con que trabajamos. Podemos y debemos ampliar nuestra noción de lo que es inteligente o razonable.

En las primeras décadas del desarrollo de la IA fue natural tratar de generar respuestas infalibles. Eso fue muy útil para la mecanización de la matemática y de la lógica. Pero, eventualmente, aceptamos que es posible ser inteligentes sin ser deductivamente infalibles. A menudo es necesario llegar a conclusiones provisionales o aproximadas. Cuando nueva información nos obliga a revisar nuestras conclusiones sin perder las premisas originales, decimos que estamos razonando “no monotónicamente”. Nuestras conclusiones se pueden perder o bloquear sin haber perdido las premisas de las que fueron obtenidas. Esto es lo que los agentes inteligentes deben ser capaces de hacer; por ello, desde hace más de cuatro décadas tenemos varias lógicas no monotónicas para estudiar estos tipos de inferencia.

En consecuencia, cuando hablamos de IA es importante fortalecer y ampliar nuestras ideas del razonamiento inteligente mediante la consideración de procesos de razonamiento no monotónico.