Privacidad en riesgo

Segunda Guerra Mundial, 1940. El ejército alemán ocupa las principales ciudades de Europa y expande el terror entre la comunidad judía. En Holanda, Jacobus Lambertus Lentz, un funcionario del gobierno, había planeado desde años atrás la compilación de datos personales para el registro de la población y el carnet de identidad de los holandeses.

El Estado rechazó su procedimiento por considerar que violaba la privacidad de sus ciudadanos. Sin embargo, para las fuerzas alemanas fue oro molido. Gracias a su plan, que fue apoyado por los invasores, y con la ayuda de la máquina Hollerith de IBM, indispensable para procesar los datos, Lentz pudo censar a la población de los Países Bajos, identificando, así, a la comunidad judía.

Otra cosa ocurrió en Francia, que tampoco tenía un registro preciso de su población. René Carmille, quien en su calidad de auditor del ejército francés tenía a su servicio algunas máquinas Hollerith, se ofreció a hacer el registro que requerían los alemanes. Pero los engañó: retardó el censo cuanto pudo y, deliberadamente, “olvidó” integrar el cómputo de la religión a la información que procesaban las Hollerith.

El contraste resultó dramático: 73% de la población judía de Holanda “murió”, contra 25% de la de Francia.

Con esta narración, la filósofa Carissa Véliz, profesora del Instituto de Ética e Inteligencia Artificial, adscrito al Hertford College de la Universidad de Oxford, Inglaterra; inició su charla con investigadores del Instituto de Investigaciones Filosóficas (IIFS) de la UNAM el mes de abril de 2022, sesión a la que tuvo acceso Nuevos Diálogos.

La parábola ilustra la importancia de la secrecía de los datos personales que Véliz quiso resaltar en su abordaje de la relación entre privacidad, inteligencia artificial y democracia: que nuestras fichas de identidad pueden ser un instrumento preciso de control y represión. Datos que, en la actualidad, están en poder tanto de gobiernos como de grandes empresas tecnológicas y de hackers.

Con la ampliación del uso de internet en todos los sectores de la vida cotidiana y el crecimiento del “internet de las cosas”, los datos viajan a una velocidad sin precedentes y son manejados en tiempo real por todo tipo de empresas.

Su reciente libro, Privacidad es poder. Datos, vigilancia y libertad en la era digital (2021), arranca con una descripción perturbadora:

Nos vigilan. Saben que estoy escribiendo estas palabras. Saben que las estás leyendo. Gobiernos y cientos de empresas nos espían: a ti, a mí y a todos nuestros conocidos. Cada minuto, todos los días. Rastrean y registran todo lo que pueden: nuestra ubicación, nuestras comunicaciones, nuestras búsquedas en internet, nuestra información biométrica, nuestras relaciones sociales, nuestras compras y mucho más.

Ya no es ciencia ficción o fantasía apocalíptica. Estamos ante lo que la filósofa denomina “capitalismo de vigilancia”. Y es que, con la ampliación del uso de internet en todos los sectores de la vida cotidiana y el crecimiento del “internet de las cosas”, los datos viajan a una velocidad sin precedentes y son manejados en tiempo real por todo tipo de empresas; mismos que, por medio de la big data, son analizados para la producción industrial y, desde luego, para apoderarse del perfil de los cibernautas.

La presencia de Carissa Véliz en la UNAM coincidió con la difusión de una noticia global: la intención del magnate Elon Musk, ceo de las tecnológicas SpaceX y Tesla, de adquirir la empresa Twitter.[*]

Para Véliz, uno de los grandes negocios que vislumbraba Musk en la red social es la adquisición de datos. Al cierre de 2021, Twitter alcanzó los 199 millones de usuarios. Cada segundo se mandaron, en promedio, 9 000 mensajes, equivalentes a 750 millones al día. Tal cantidad de información ofrece la posibilidad de establecer un registro personal de los usuarios. Agrega:

El modelo de negocio de Twitter es vender datos. Las búsquedas, las charlas con los amigos, los contactos con otras aplicaciones o redes sociales, todas esas referencias se compilan para ser vendidas a bancos, aseguradoras e, inclusive, gobiernos; y ellos, a su vez, las comercializan con quien desee comprarlos.

El caso de la consultora política Cambridge Analytica refrenda la exposición de la filósofa. En 2016, Facebook entregó la privacidad de 87 millones de sus usuarios, cuyos datos fueron vendidos a la consultora para incidir en las elecciones presidenciales de Estados Unidos. Donald Trump ganó los comicios por la considerable diferencia de 70 000 votos en los swing states, aquellos que definen el desenlace en una contienda reñida.

Para cerrar su exposición, Carissa Véliz recordó que el derecho a la privacidad está contenido en la Declaración Universal de los Derechos del Hombre como uno de los mecanismos para evitar la repetición de los genocidios registrados en la Segunda Guerra Mundial. Un derecho que debe hacerse valer en nuestras democracias.

Delegar en la máquina la “toma de decisiones”

La conductora desplazaba su Uber Volvo autónomo modelo XC9O por una de las tranquilas carreteras de Tempe, Arizona. La tarde había cedido su reino a la templada noche de la primavera desértica. Nada más propicio para dejar rodar su auto sobre el asfalto y aprovechar el tiempo del viaje para disfrutar, a través de su teléfono inteligente, de una buena serie.

Sus sentidos delegaron la seguridad de la conducción a los sensores del vehículo, presuntamente infalibles. De pronto percibió que el auto golpeó algo sólido que lo desestabilizó. La cámara interior del Volvo registró su sobresalto cuando advirtió que había arrollado a una mujer, dejándola herida de muerte.

Luego de enfrentar un juicio, la conductora fue encontrada culpable de homicidio imprudencial. ¿Su imprudencia? Transferir a la máquina la decisión de actuar ante un imprevisto. Era de noche. La mujer arrollada usaba ropa oscura y atravesó la carretera por un tramo vedado a los peatones. El Volvo no supo detectar a la mujer de 49 años y no detuvo su marcha.

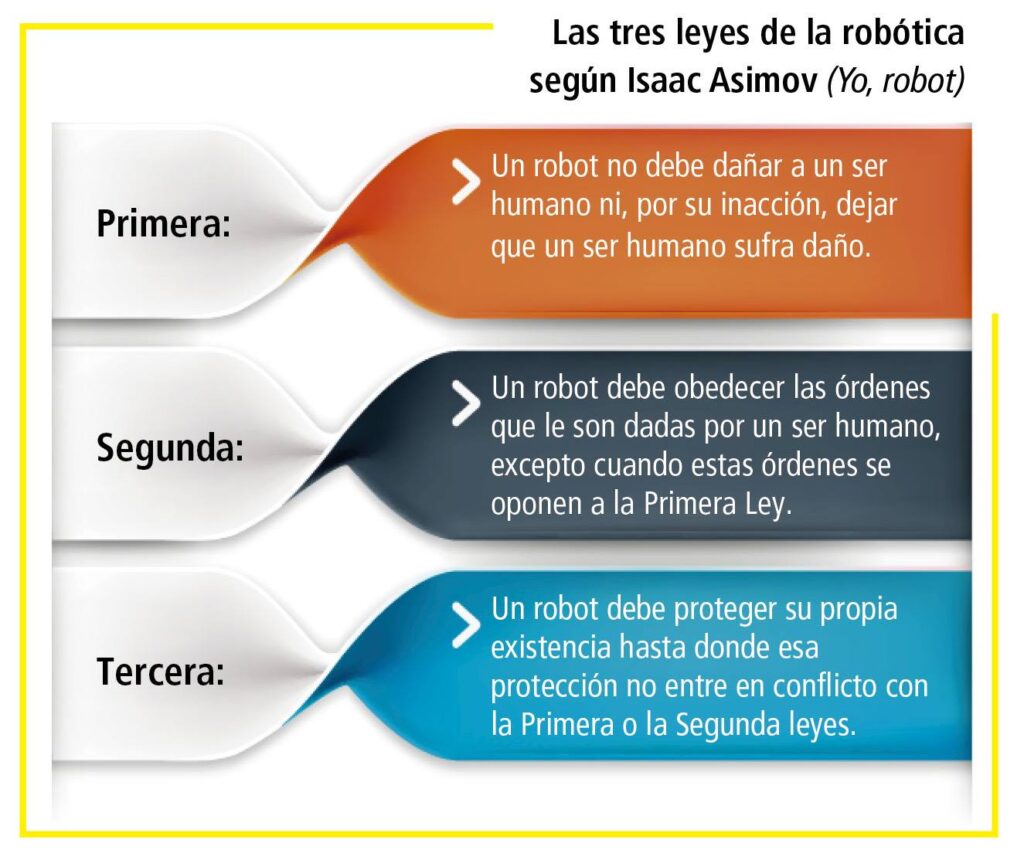

Google y Tesla buscan que sus vehículos autónomos sean provistos de “controles algorítmicos de sentido ético”, para prevenir daños a los usuarios y a los peatones, de acuerdo con las leyes de la robótica que planteó Isaac Asimov.

La prensa divulgó la noticia como la primera muerte causada por un vehículo autónomo en Estados Unidos. Después de este accidente, sucedido en marzo de 2017, se han presentado otros del mismo tipo. El más reciente fue en París, Francia, en diciembre de 2021, cuando un Uber autónomo se aceleró de manera espontánea y causó la muerte de un ciclista.

Ambos casos representan una pequeña muestra de los riesgos que implica el uso de las nuevas tecnologías y, por ello, de la cautela con la que debe avanzar la IA.

Consultado al respecto, Jorge Enrique Linares Salgado, exdirector de la Facultad de Filosofía y Letras de la UNAM, experto en ética de la ciencia y la tecnología, comenta que existe la disposición en Google y Tesla para que los vehículos autónomos que desarrollan sean provistos de “controles algorítmicos de sentido ético”, con el fin de prevenir daños a los usuarios y, sobre todo, a los peatones, de acuerdo con las leyes de la robótica que planteó Isaac Asimov.

En ese sentido, continúa Linares, los vehículos autónomos, y cualquier otro sistema de IA, deben ser diseñados para no causar daños al ser humano de forma intencional ni por accidente, exigencia que debe cumplirse por encima de todo, incluso, de su autodestrucción. Considera, empero, que a pesar de los recursos que invierten las empresas tecnológicas en sus investigaciones, los resultados no son claros. Tampoco han hecho público los controles que deben tener los algoritmos para evitar riesgos a los humanos y demás seres vivos.

En el caso del accidente en la ciudad de Tempe, la conductora determinó dejar que su auto se condujera sin su asistencia, lo que fue un error. Por este tipo de situaciones es que, para el filósofo, la toma de decisiones es un punto central en el desarrollo de las aplicaciones:

Tomar decisiones es propio de los seres humanos frente a situaciones de incertidumbre e, incluso, novedosas, en las que uno debe ponderar, imaginar la posibilidad de los escenarios y preferir una opción. A veces no se puede no elegir, sino que debemos optar por la menos mala entre las posibilidades.

Los sistemas de IA están programados para tomar decisiones a partir de la información que se les ha integrado. “Ahora bien, lo que no se ha podido replicar es la capacidad adaptativa que tenemos nosotros los animales para recordar antiguas decisiones, comparar y, digamos, enfrentarse a una situación nueva”, destaca Linares Salgado.

Un sistema de IA lo haría en el marco de su base de datos y sobre su algoritmo. Aunque Linares acepta que con el desarrollo del aprendizaje profundo la máquina puede ir aprendiendo con base en su propia experiencia, también remarca que, en situaciones de mucha incertidumbre, el programa no sabría actuar adecuadamente.

Ante el debate sobre la toma de decisiones en los softwares, el autor de Adiós a la naturaleza. La revolución bioartefactual (2019) señala que el problema está planteado en dos documentos: Recomendación sobre la Ética de la Inteligencia Artificial, de la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (Unesco, 2022), y en la Declaración de Montreal para el Desarrollo Responsable de Inteligencia Artificial, publicada en diciembre de 2018 por la Universidad de Montreal, Canadá.

En ambos documentos se insiste en que la IA debe ser, siempre, un auxiliar para tomar decisiones porque “ofrece datos procesados en volúmenes muy grandes que ninguna mente humana puede tener. Son datos muy valiosos, estadísticos, que se compilan en tiempo real”. Pero, al mismo tiempo, subrayan que ningún sistema de IA debe tomar decisiones por sí mismo y, mucho menos, en contextos que impliquen consecuencias de vida o muerte.

El problema, alerta Linares Salgado, es que “no se está cumpliendo”:

Lo que hacen los sistemas inteligentes es suplantarnos: nos volvemos dependientes y tomamos juicios a partir de lo que nos dicen las aplicaciones. Esto es uno de los peligros más importantes. Las personas se están acostumbrando a depender de los sistemas de IA. El problema es que pueden fallar. Entonces, de muchas formas, fallamos: a causa de un error del diseño algorítmico o debido a sesgos que son introducidos inconscientemente por los humanos que los diseñan.

Los documentos señalados por Linares delinean los principios que se pretenden comunes, a nivel internacional, para crear una normativa que garantice un desarrollo positivo de la IA. “Por lo pronto, son llamados –digamos– a la responsabilidad, tanto las empresas como de los Estados. No obstante, estos últimos no parecen estar tomando las decisiones adecuadas”:

Han dejado, como siempre, que las empresas se desarrollen sin ninguna regulación. Están esperando que surjan los problemas, y esa es una mala decisión racional, por cierto, muy típica en los seres humanos de la modernidad. Primero desarrollamos las cosas y después vemos cuáles son los problemas. Cuando advertimos que son graves, tomamos medidas para regular un sistema tecnológico. Esa ha sido la lógica industrial que tiene en el fondo el razonamiento derivado de la misión del lucro.

En resumen, indica Linares:

No se están tomando las medidas pertinentes de regulación. El sector industrial suele expresar que las reglamentaciones, antes de producir, impiden la libertad de desarrollar los prototipos; o que son una restricción muy seria a la creatividad en sus diseños, lo cual es absolutamente falso. Por tanto, como en otras épocas, no existe una regulación adecuada, formal, legal, sobre cómo se debe desarrollar esta tecnología.

Salud, energía y cambio climático

Pero no todo lo que se deriva de la IA conlleva esos riesgos. En México, por ejemplo, ingenieros de la UNAM desarrollaron un método basado en IA para pronosticar la potencia eólica del territorio por medio de información meteorológica registrada desde hace décadas.

En abril de 2022, el Sistema de Administración Tributaria (SAT) de la Secretaría de Hacienda reportó que la recaudación de impuestos aumentó 76% en los últimos tres años gracias a la utilización de IA y robots, especie de “terminators fiscales” que recuperaron una buena cantidad de adeudos.

A nivel global, en el contexto de la pandemia por covid-19, la IA jugó un papel relevante. La esperanza de controlar el avance del virus llevó a los desarrolladores de sistemas a trabajar con los inconmensurables datos que la emergencia arrojaba.

El documento ¿Cómo puede la inteligencia artificial ayudar en una pandemia?, emitido por el Banco Interamericano de Desarrollo (BID), señala el potencial de las nuevas herramientas. Un soporte múltiple que incluye desde el diagnóstico de la enfermedad con base en imágenes, cómputo de proteínas relacionadas con el virus y verificación de la existencia de fármacos para tratar el padecimiento, hasta la identificación de noticias falsas sobre la pandemia para evitar su propagación.

Entre esos esfuerzos cabe mencionar que investigadores del Instituto de Ciencias Nucleares (INC) de la UNAM, en colaboración con médicos de la Universidad Autónoma Metropolitana (UAM) y del Hospital ABC, crearon una aplicación para identificar a los pacientes con prioridad de atención médica debido a sus comorbilidades.

Otro de los frentes que reclaman la intervención urgente de tecnologías de punta es el relativo al cambio climático. Si bien el uso de la IA en temas ambientales se redujo en los últimos dos años por falta de recursos, la ciencia de los datos ha demostrado una gran eficacia para analizar y combatir el calentamiento del planeta.

Según el informe IA climática: Cómo puede la inteligencia artificial impulsar su estrategia de acción climática, realizado por la consultora francesa Capgemini, la IA ha contribuido a reducir los gases de efecto invernadero en 13%.

El documento estima que, si los gobiernos y la industria estimulan la utilización de la IA, en 2030 las entidades productivas podrán cubrir entre 11% y 45% de las expectativas de “intensidad de las emisiones económicas” propuestas en el Acuerdo de París. Esto representaría un avance significativo en la lucha contra el deterioro ambiental y el incremento de la temperatura en el planeta.

Más allá de la ciencia ficción y más acá de los miedos apocalípticos, la IA y sus aplicaciones están cambiando las formas de vida, trabajo y convivencia a lo largo y ancho de la aldea global. ¿Para bien o para mal? No hay respuesta que neutralice la incertidumbre. Aunque el filósofo Jorge Enrique Linares aportó una clave: Aristóteles consideraba que la capacidad de tomar buenas decisiones es una virtud que deben cultivar los hombres.

NOTA

[*] Luego de muchas dudas, el 27 de octubre de 2022 se confirmó finalmente la compra de esta red social por parte del magnate sudafricano en una operación valorada en unos 44 000 millones de dólares, 24 horas antes de cumplirse el plazo dado por una jueza en Estados Unidos para abrir un proceso si no se cumplía con la transacción.